Khoản tiền này nâng tổng số tiền Groq huy động được lên hơn 1 tỷ USD và định giá công ty ở mức 2,8 tỷ USD.

Groq đang tạo ra bộ xử lý ngôn ngữ (LPU) được cho là nhanh hơn bộ xử lý đồ họa (GPU) của Nvidia. Công ty tuyên bố rằng LPU của họ có thể chạy các mô hình AI tạo sinh hiện có có kiến trúc tương tự như ChatGPT và GPT-4o của OpenAI với tốc độ gấp 10 lần và năng lượng chỉ bằng một phần mười.

Mặc dù GPU hiện đang được xem như là tiêu chuẩn công nghiệp để chạy các mô hình AI. Tuy nhiên, một số kết quả ban đầu cho thấy LPU có thể là đối thủ đáng gờm với sản phẩm của Nvidia.

Nvidia đã khẳng định vị thế là công ty dẫn đầu không thể tranh cãi trong lĩnh vực phần cứng trí tuệ nhân tạo (AI). Với nền tảng sâu rộng, Nvidia nắm giữ vị thế gần như độc quyền trong các trung tâm dữ liệu khi tận dụng đà phát triển của trí tuệ nhân tạo tạo sinh (GenAI) vào cuối năm 2022.

Nvidia ước tính kiểm soát 70% đến 95% thị trường chip AI được sử dụng để đào tạo và triển khai các mô hình AI tạo sinh, và Nvidia cũng đang thực hiện các hướng đi mạnh mẽ để duy trì sự thống trị của mình.

Thiết kế sáng tạo và kiến trúc độc đáo của Groq đặt ra mối đe dọa nghiêm trọng đến sự thống trị của Nvidia trong lĩnh vực AI. Mặc dù Nvidia vẫn là một gã khổng lồ trong lĩnh vực này, sự xuất hiện của các đối thủ cạnh tranh như Groq chứng minh rằng cuộc chiến vì tương lai của AI vẫn chưa kết thúc.

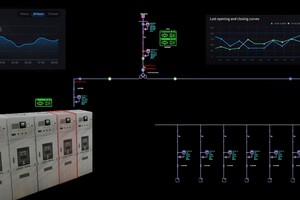

Groq được thành lập bởi cựu kỹ sư Google Jonathan Ross, đã tạo nên làn sóng với việc ra mắt bộ xử lý ngôn ngữ (LPU), một con chip mang tính cách mạng hứa hẹn sẽ tăng tốc đáng kể quá trình tạo phản hồi của chatbot. Công nghệ này, dựa trên Tensor Stream Processors (TSP), nổi bật với hiệu quả và khả năng thực hiện trực tiếp các phép tính AI, giúp giảm tổng chi phí và có khả năng đơn giản hóa các yêu cầu về phần cứng cho các mô hình AI quy mô lớn.

Groq đang định vị mình là một thách thức trực tiếp đối với Nvidia, nhờ kiến trúc bộ xử lý độc đáo và thiết kế Tensor Streaming Processor (TSP) sáng tạo. Phương pháp này khác với cấu trúc Tensor Processing Unit (TPU) của Google, sẽ mang lại hiệu suất vượt trội trên mỗi watt và hứa hẹn khả năng xử lý lên tới 1.000 tỷ phép tính mỗi giây (TOPS), cao gấp bốn lần so với GPU hàng đầu của Nvidia.

Ngoài Nvidia, Groq còn cạnh tranh với Amazon, Google và Microsoft, tất cả đều cung cấp (hoặc sẽ sớm cung cấp) chip tùy chỉnh cho khối lượng công việc AI trên đám mây.

Để tạo ra chỗ đứng riêng, Groq đang đầu tư mạnh vào hoạt động tiếp cận các doanh nghiệp và chính phủ.

Vào tháng 3, Groq đã mua lại Definitive Intelligence - công ty cung cấp một loạt các giải pháp AI hướng đến doanh nghiệp - để thành lập một đơn vị kinh doanh mới có tên là Groq Systems. Phạm vi hoạt động của Groq Systems là phục vụ các tổ chức, bao gồm các cơ quan chính phủ Mỹ và các quốc gia khác, những tổ chức muốn thêm chip của Groq vào các trung tâm dữ liệu hiện có hoặc xây dựng các trung tâm dữ liệu mới bằng bộ xử lý Groq.

Gần đây hơn, Groq đã hợp tác với Carahsoft - nhà thầu công nghệ thông tin của chính phủ - để bán các giải pháp cho các khách hàng khu vực công.

Groq cũng đang hợp tác với công ty tư vấn Aramco Digital của Ả Rập Xê Út để lắp đặt LPU tại các trung tâm dữ liệu trong tương lai ở Trung Đông.

Đồng thời, với việc thiết lập mối quan hệ với khách hàng, Groq đang tiến tới thế hệ chip tiếp theo của mình. Tháng 8/2023, công ty đã thông báo rằng sẽ ký hợp đồng với công ty bán dẫn Global Foundries để sản xuất LPU 4nm, dự kiến sẽ mang lại hiệu suất và hiệu quả cao hơn so với chip 13nm thế hệ đầu tiên của Groq.

Groq cho biết họ có kế hoạch triển khai hơn 108.000 LPU vào cuối quý I/2025.